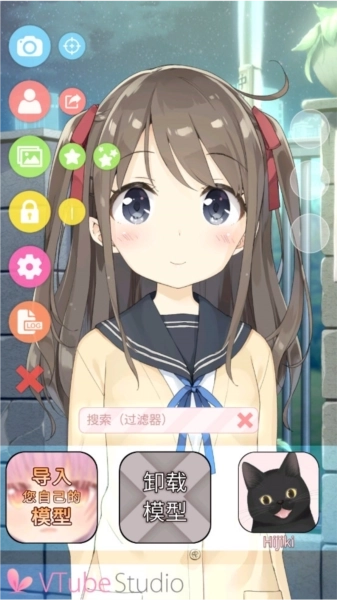

VTubeStudio中文版是一款相当出色的虚拟形象制作工具,借助它,用户能够打造出契合自身风格的虚拟角色——既可以让这个角色成为live2d虚拟主播,也能将其融入拍摄的视频或照片里。软件支持动态面部特效与声音变声功能,动作细节的还原度很高,用户甚至还能和自己创建的虚拟角色互动。VTubeStudio了一些基础的示例模型,但显然大家更倾向于导入自己制作的模型。需要注意的是,该软件仅兼容Live2D立体模型,暂不支持VRoid等其他格式,且目前没有扩展支持其他格式的计划。

1、模型管理方法、导进和免费,可即时转换模型

2、将模型设定为动态桌面

3、与模型开展合照7、展示live2d模型,播放视频模型视频语音、表明视频语音文字等

4、背景管理方法,支持从相册图片导进照片做为背景

5、调节模型部位、两指放缩和挪动

6、与模型开展互动,根据触碰、滚动等手式

1、可将自主设计的角色模型导入软件中使用,并且支持在直播场景下应用该模型。

2、依托精准的捕捉技术,可适配普通摄像头进行面部捕捉,即便是手机也能实现面捕功能。

3、支持自定义角色并制作趣味表情,这些表情能在直播时触发使用,互动效果十分有趣。

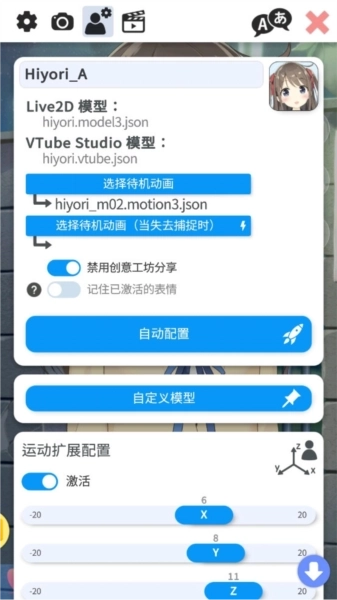

模型载入完成后,你可以在VTubeStudio的模型设置栏里查看相关的模型设置。

在最顶部,你能够为模型命名,这个名称会出现在模型选择栏里。在下方区域,你可以看到Live2D模型的文件名以及自动生成的VTubeStudio模型文件(即VTS模型)。

你可挑选一个图标(.jpg或.png格式的文件,点击右上角图标即可打开文件选择界面)以及模型的默认待机动画(.model3.json格式)。模型文件夹里的任意文件都能供你选择。

【模型移动】

通过“模型移动”功能设置,您能够依据头部所处位置,让模型实现向左或向右的平移,以及靠近或远离屏幕的前后移动。借助滑块,您可以对模型移动的幅度大小进行调整。

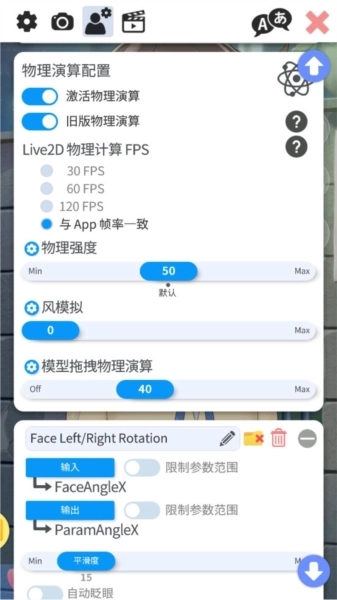

【物理设置】

在这里,你可以调整Live2D物理设置的效果强度,无论是增强还是减弱都可以实现。另外,你还能开启“风”功能,它会随机给物理系统施加一个类似风的作用力。不过需要说明的是,这个功能目前还在试验阶段,最终呈现的效果可能不太理想,具体情况会因模型的设置方式而有所不同。

VTubeStudio此前未重视Live2D物理设置的“有效性”功能,这一问题在近期的更新里得到了修正。若想开启“有效性”设置,需先确保“旧版物理”选项处于未开启状态。

【VTS参数设置】

这是你模型设置里最关键的部分。在这个地方,你可以对Live2D参数进行设置,使其与面部追踪参数相对应并受其控制。

总而言之:

你能够灵活地把任意输入参数(比如面部追踪、鼠标操作等)对应到任意输出参数(即Live2D参数)上。

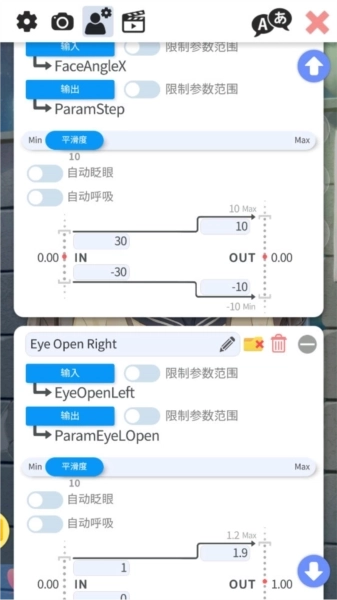

数值的映射方式能够自由设置。比如,输入参数MouthOpen的取值区间为[0,1],其中0代表闭合,1代表彻底张开。要是你的Live2D参数(像名为ParamMouthOpen的参数)的取值区间是[-10,10],你就可以对这个区间进行映射,使(IN,0)与(OUT,-10)相对应,(IN,1)与(OUT,10)相对应。或者你也可以用其他的方式来映射它,不存在任何约束。

红点将显示值在当前输入和输出范围内的位置。

通过启用“范围限制”功能,能够保证输入或输出的数值不会超出你预先设定的范围。同时,这还能让数值在临近极限时更平缓地趋于稳定。

一般来说,建议只修改输出范围,输入范围保持不变。

更高的平滑度可减少动作的抖动情况,不过会带来动作滞后的问题。建议多尝试不同的平滑度数值,直至找到每个参数对应的合适值。在iOS系统中,通常你几乎无需对平滑度进行调整。

自动呼吸功能会让输出参数像呼吸一样产生浮动变化。启用此选项后无需输入参数,所有已输入的参数都会被忽略。

自动眨眼功能会随机将参数值降至零。该功能可以和任意一个参数搭配使用,但这并非强制性要求。

1、导入角色模型

2、对角色表情通道进行映射(Live2D模型无需此操作)

对于3D模型来说,在进行面捕、声音捕捉、自动看镜头以及自动眨眼这些操作之前,必须先正确映射角色的表情通道,不然的话,面捕之类的功能就无法正常运行。

3、开启“摄像头面部捕捉”

(1)选择输入设备

(2)开启“摄像头面部捕捉”按钮

此时,角色已经实时同步表情啦~~~

要是你觉得面部呈现的效果不太理想,可以通过调整眼部、嘴部或眉毛的平滑度与放大程度来进行细节上的效果优化。

要是你担心直播时出现意外状况,又不想露出自己的脸,那就可以勾选“显示面具”这个选项。

如果,你需要头部,上半身旋转,可以勾选这两项

要是摄像头位置偏斜,导致角色面部捕捉时头部和身体出现歪斜的情况,我们可以借助调整偏移值来解决这个问题。

v1.28.15:

优化后的性能表现,以及多项小问题的修复,其中涵盖了对失效的屏幕热键按钮的修复。

下载排行